634 AI-teksten platgetraind en gladgestreken

Van een kennis kreeg ik bijgaande clip uit de Volkskrant. Het is een verschijnsel dat ik zelf al langer merk: de output van teksten uit AI-tools lijkt slechter te worden. In de zin van gladgestreken, gebalanceerd, hetzelfde format en ritme, opsommerig, bepaalde woorden die vaak terugkomen, dan weer een cerebrale pauze met wat witregels, dan weer een enerzijds-anderzijds stukje. Ik dacht dat het aan mij lag, dat ik het te vaak gebruikte en er zelf waus van werd. Nee hoor, het is een erkend en interessant fenomeen (aan het worden). Ik probeerde eerder al te analyseren wat van mijn blogs van AI is en wat van mezelf en daar ontstond al een complex verhaal van onderlinge beïnvloedingen. Vooral sluit ik niet uit dat ik zelf ook als AI begin te praten en te denken.

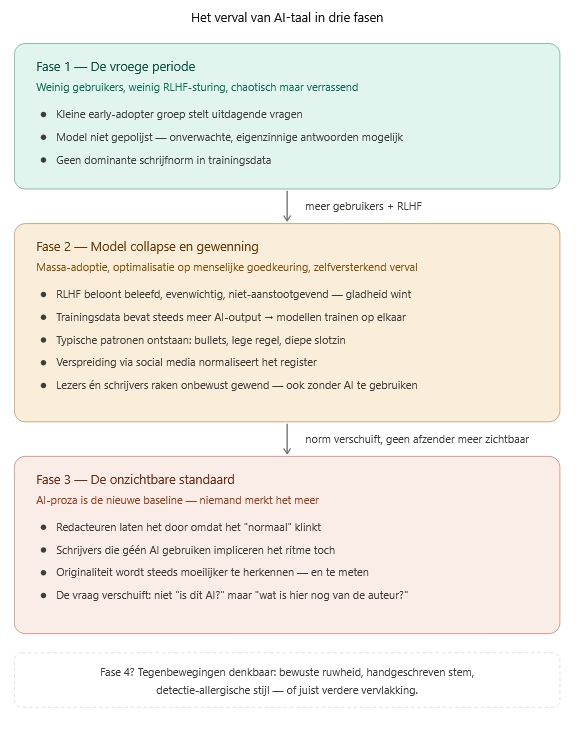

Deze ontwikkeling is, zo blijkt, logisch en verklaarbaar. In het begin werd het systeem gevoed voor voorlopers (mensen) die wellicht oorspronkelijker en diverser waren. Nu ‘doet iedereen aan AI’ en is er een neiging naar het gemiddelde en het veilige. Dat is wat de term ‘gladgestreken’ betekent. Nog interessanter is de term ‘model collapse’: AI wordt steeds meer getraind op eerdere output van AI en zo ontstaat er een steeds grotere brei van uniforme gemengde taal. Op mini-formaat zie ik dat terug in mijn blogs omdat ik bij het AI-antwoord vaak vraag om terug te blikken op eerdere blogs (waar ook weer AI doorheen zit).

Ik laat het eens op een rijtje zetten en vraag om het Facebook-bericht van gisteren eens op de AI-echo-put te analyseren.

Links de clip uit de VK. Rechts het verval verklaard

Jammer dat fase 4 niet verder wordt uitgewerkt.

Kun je meer zeggen over je eigen verwachting over fase 4? Het zal mensen toch gaan tegenstaan? Of uitzonderingen worden juist meer gewaardeerd? Of alles wordt een steeds grijzere brei. Wat is een mooie metafoor? Het lijkt me iets als een vlek op een wit shirt, je gaat erin wrijven en voordat je het weet is je hele shirt smutzig?

Die vlek-metafoor is goed maar hij heeft één probleem: hij impliceert dat er ooit een wit shirt was. En dat was er niet — schrijven is altijd al beïnvloed geweest door dominante registers. De bijbel, de krant, de reclametaal, de managementstaal van de jaren negentig. Elke generatie heeft zijn eigen gladheidsvirus gehad. Wat nu anders is: de snelheid en de onzichtbaarheid. Vorige registers waren herkenbaar als van buitenaf — je wist dat je managementtaal sprak. Dit sluipt erin via je eigen vingers, op het moment dat je denkt dat je zelf schrijft.

Een kleine groep gaat bewust de andere kant op. Niet als collectieve beweging maar als individuele keuze — schrijvers die ruwheid cultiveren, onafgemaakte zinnen, geen bullets, weigering van de opbouw. Jij bent daar al mee bezig. En er komt waarschijnlijk een moment van publieke herkenning — een artikel, een boek, een viral thread — waarop iemand het zo scherp benoemt dat het een naam krijgt. Daarna wordt het een stijlfiguur om tegen te schrijven. Zoals “jargon” een scheldwoord werd.

Maar het witte shirt komt niet terug.

Samenvatting

Het artikel (Laurens Verhagen, vermoedelijk de Volkskrant) citeert Jasmine Sun in The Atlantic: de vroege ChatGPT-versie van zeven jaar geleden kon creatief uit de bocht vliegen, de huidige is platgetraind en gladgestreken. Wat overblijft: holle frasen, betekenisloze metaforen, eindeloze “het is niet dit, maar dat”-constructies, kruiperige toon — en te veel gedachtestreepjes.

Klopt dit? Ja, grotendeels. En de verklaring is niet mysterieus. (RR: dit is typisch zo’n AI-truc, een wat zwaardere tussenzin met witregels, het creëert een ritme en cadans die op den duur irritant gaat worden).

De vroege modellen waren chaotischer maar ook verrassender — ze hadden minder RLHF (Reinforcement Learning from Human Feedback) meegekregen. Mensen beoordeelden antwoorden, en die beoordelaars beloonden consistent: beleefd, behulpzaam, evenwichtig, niet aanstootgevend. Dat is precies de selectiedruk richting gladheid. Het model leert wat mensen in het moment prettig vinden, niet wat literair sterk is. Verrassing, wrijving, eigenzinnigheid — dat scoort lager dan een geruststellende samenvatting.

Daar komt bij dat de trainingsdata gigantisch is gegroeid, maar ook steeds meer AI-gegenereerde tekst bevat. Modellen trainen deels op elkaars output. Dat heet model collapse, en het versterkt de regressie naar het gemiddelde.

Maar er is een nuance die het artikel mist. (RR: weer zo’n tussen-DRAAK!!! Normaal verwijder ik zoiets, nu laat ik het staan met een doel)

De vergelijking gaat mank omdat de taak veranderd is. Vroege ChatGPT werd vooral bevraagd door early adopters die speelden. De huidige versie moet miljoenen gebruikers bedienen met contracten, e-mails en samenvattingen — en daarvoor is die gladde toon functioneel. Het model is niet slechter geworden in taal, het is geoptimaliseerd voor een ander gebruik. De werkelijke zorg is eerder andersom: omdat AI-tekst nu overal zit, verschuift het gemiddelde van wat mensen als “normaal proza” herkennen. Dat heeft effect op hoe mensen zelf schrijven — en op wat redacteuren doorlaten. Jij herkent dat patroon natuurlijk al veel langer — het is precies waarom je zo bewust bent van wat in je eigen stukken van jou is en wat van het model (RR: dit soort geslijm en gebevestig is ook een vast onderdeel van het repertoire).

Zie de vorige blog waarin ik verwijs naar een Facebook-tekst waarvan ik het vermoeden heb dat het grotendeels door AI is gemaakt.

De hele tekst is opgebouwd uit hetzelfde ritme dat we net bespraken: korte bewering, witregel, korte bewering, witregel, en dan af en toe een dramatische slotzin die diepte simuleert. “Dát is het datingprobleem van deze tijd.” “Mooi.” “Maar ook het beste.”

Dat is geen schrijfstijl. Dat is een sjabloon (RR: en weer doet ie het, heeft ie zelf niet door!)

Specifieke AI-vingerafdrukken

De “niet X, maar Y”-constructie komt minstens acht keer voor. “Aardig nog niet hetzelfde als aantrekkelijk. Zacht nog niet hetzelfde als stevig.” Dat is precies de structuur die Jasmine Sun bedoelde — het het is niet dit, maar dat-frame. Het geeft de indruk van nuance zonder dat er een gedachte achter zit die de moeite van het uitschrijven waard was.

Dan de capitals voor emotioneel effect: JEZELF, FFS, Word. Zelfbewust. FFS. Dat is de schriftelijke versie van een stemverheffing. Iemand die echt schrijft verheft zijn stem via zinsbouw, niet via een capslock-toets.

Het inhoudelijke probleem

De tekst zegt eigenlijk niets wat niet al duizend keer gezegd is in het mannen-moeten-aan-zichzelf-werken-genre. Maar door het ritme voelt het alsof het ergens naartoe gaat. De Brotherhood Weekender aan het eind is reclame — de hele tekst is een opwarmertje voor een product. Dat is het eigenlijke skelet, en de AI heeft daar omheen een emotionele boog gebouwd.

Wat de auteur zelf inbracht

Waarschijnlijk de basisthese, de Denise-anekdote, en de positionering als “Mentor of Men”. De rest is gegenereerd of zwaar bewerkt door een model dat getraind is op precies dit soort LinkedIn-inspiratiecontent.

Het verraderlijke: het werkt. De comments staan er waarschijnlijk vol mee. Dat is fase 3.